在ComfyUI中使用更轻量化的反推模型:Florence2

9/7/2024, 6:34:57 PM | 热度:1482 | 阅读本文需 2 分钟

点赞

Florence-2 是一种高级视觉基础模型,它使用基于提示的方法来处理各种视觉和视觉语言任务。 Florence-2 可以解释简单的文本提示,以执行字幕、对象检测和分割等任务。 它利用我们的 FLD-5B 数据集(包含 1.26 亿张图像中的 54 亿条注释)来掌握多任务学习。 该模型的序列到序列架构使其在零镜头和微调设置中都表现出色,被证明是一个有竞争力的视觉基础模型。

安装方法

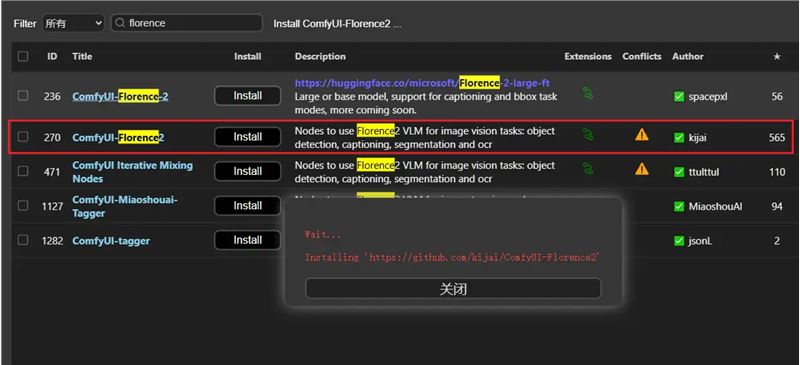

管理器安装节点:

我们搜索florence然后下载作者为kijai的节点,安装完成后重启ComfyUI,如果管理器安装不上的话可以手动安装哦

还不知道这么安装插件的小伙伴可以看这一篇哦:https://aisc.chinaz.com/jiaocheng/10103.html

安装模型

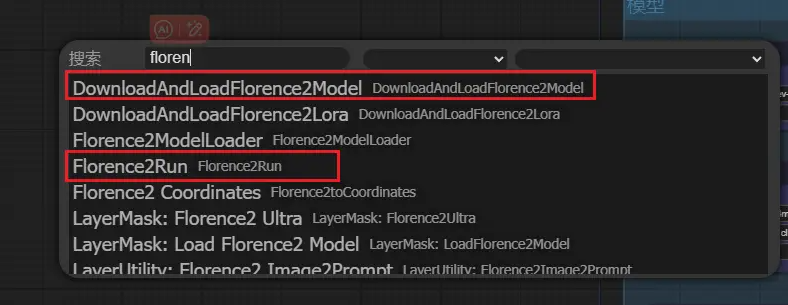

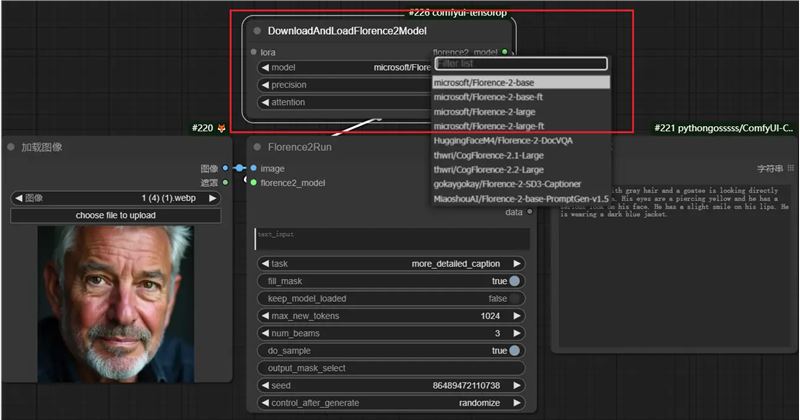

安装完成后我们,我们需要加载这两个核心节点来下载模型

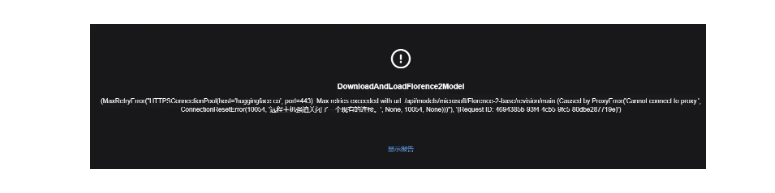

节点会帮我们自动下载模型,但是网络不好容易报错

所以我们也可以点击下方的链接去手动下载模型,把下载的模型放在ComfyUI/LLM

文件夹中。

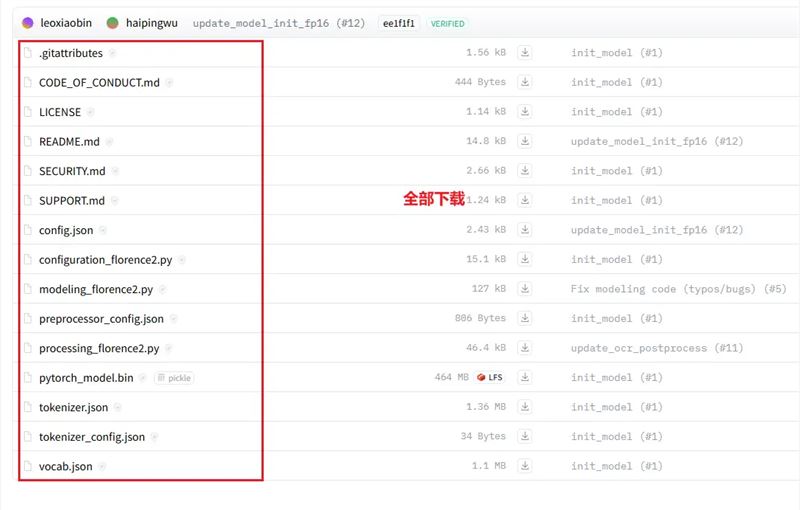

Base版本:https://huggingface.co/microsoft/Florence-2-base

Large版本:https://huggingface.co/microsoft/Florence-2-large

文档识别版本:https://huggingface.co/HuggingFaceM4/Florence-2-DocVQA

一般电脑我们下个base版的就可以,最求效果的还是下载large最好

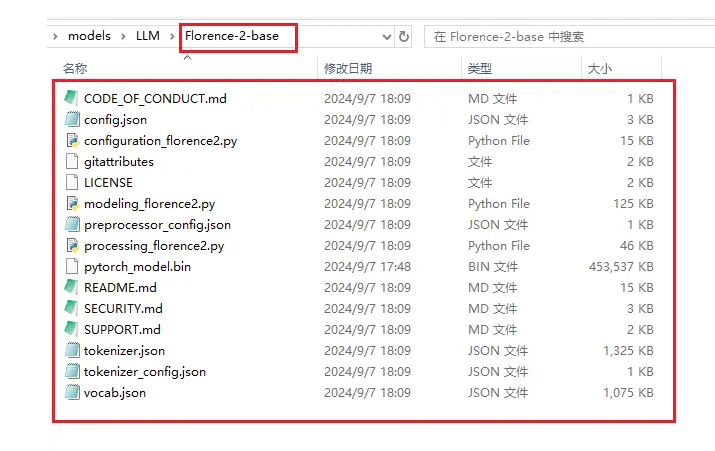

如果是手动下载的话我们需要全部下载,然后在LLM下新建一个文件夹把全部文件放入

这样节点才能识别到模型

可以看到还是非常轻量化的才 400 多M

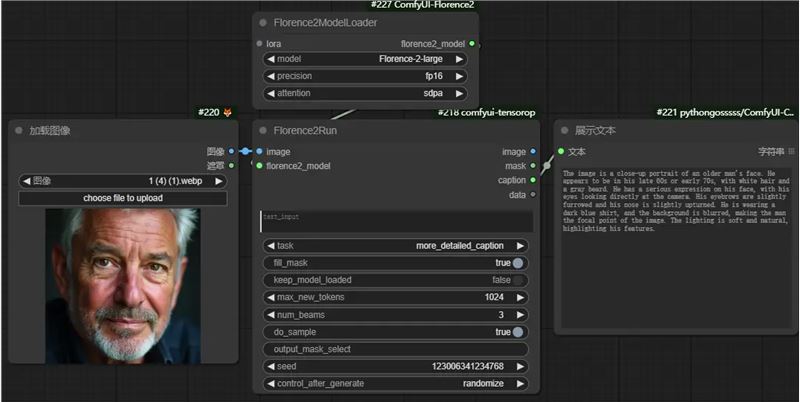

反推效果

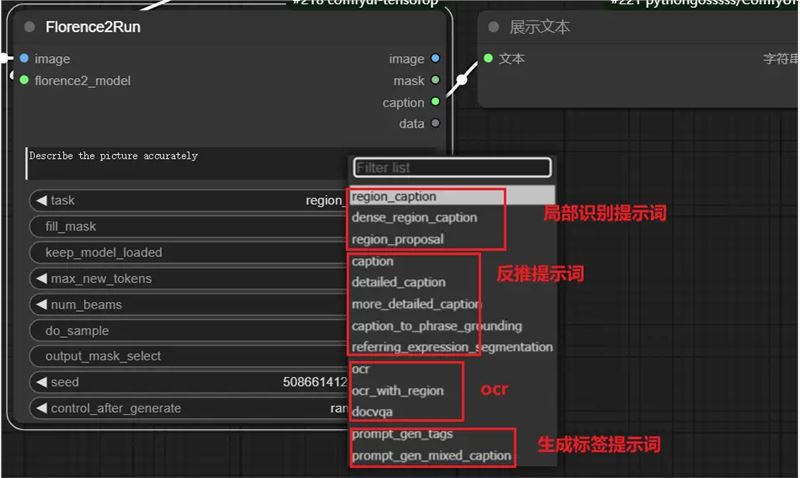

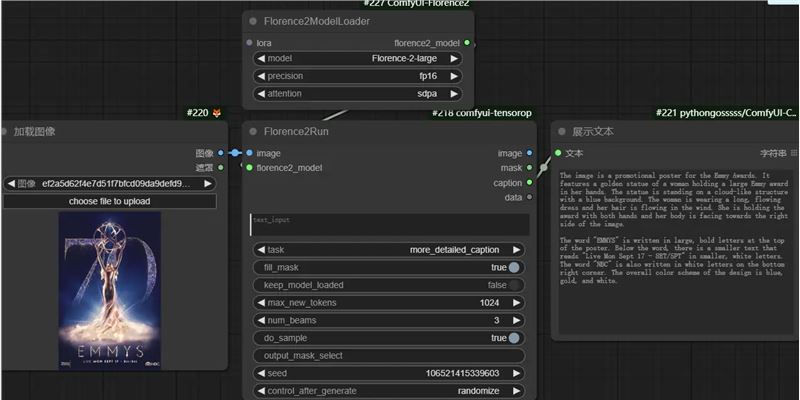

节点中比较重要的是task这个参数,不同的task输出的内容也不一样,我这边简单做一个区分,也没有全部试用,大家可以切换不同的看看区别

我用的Large模型反推的还是比较精细的

测试2:

来个复杂一点的带文字的

我觉得效果还是非常不错的,虽然没有JoyCaption那么好,但是胜在轻量,而且速度也非常有优势,对场景要求没那么高的话还是非常值得使用的

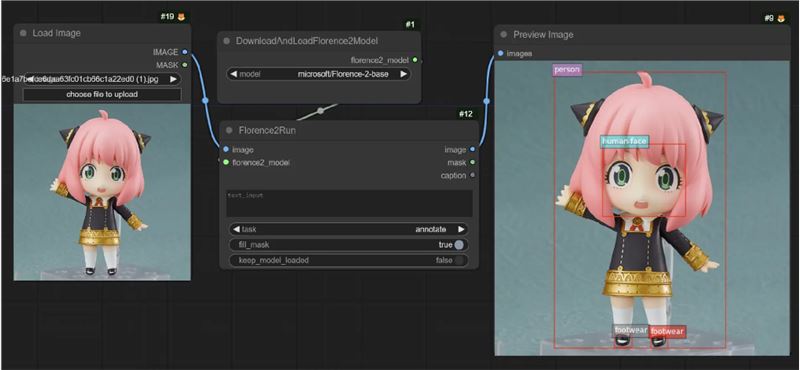

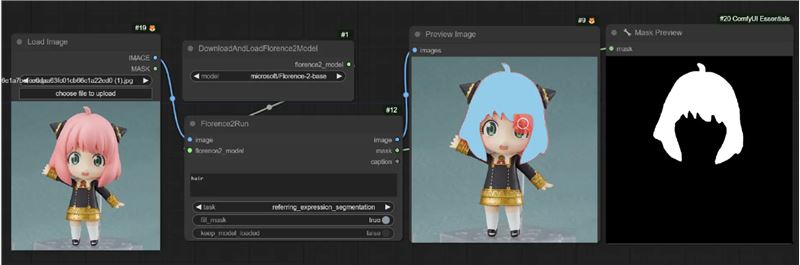

生成图片与遮罩

节点会输出一个图像,图像上会标记一些识别的区域,还可以根据识别到的物体生成遮罩,也是非常方便的

除了打标我们还可以用来当OCR文本识别

要使用 DocVQA 功能:

- 将文档图像加载到 ComfyUI 中。

- 将图像连接到 Florence2 DocVQA 节点。

- 输入您关于文档的问题。

- 该节点将根据文档的内容输出答案。

示例问题:

- “这张收据上的总金额是多少?”

- “这张表格上提到的日期是什么?”

- “这封信的寄件人是谁?”

注意:答案的准确性取决于输入图像的质量和问题的复杂程度。

1

文章目录

安装方法

安装模型

反推效果

生成图片与遮罩

除了打标我们还可以用来当OCR文本识别

AI教程交流群

扫描二维码加入群聊

与同行学习交流&资源共通

© CopyRight 2002-2024 ,CHINAZ.COM , Inc.All Rights Reserved.