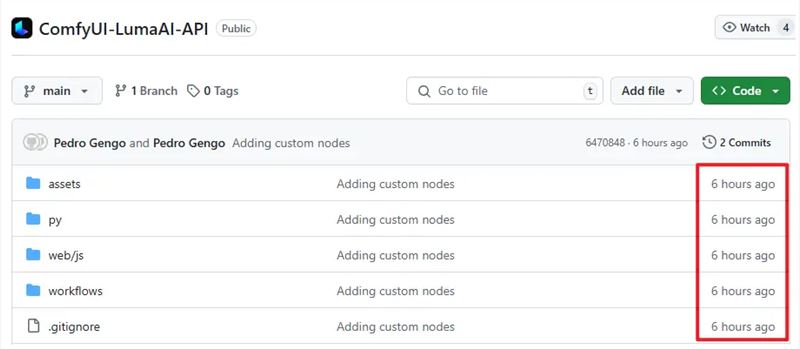

就在前几个小时,LumaAI(AI视频的那个网站)发布了他们 ComfyUI 的自定义节点,允许用户直接在 ComfyUI 中使用 Luma AI API。Luma AI API 基于 Dream Machine 之上,Dream Machine 是 Luma 开发的视频生成模型

项目地址:github.com/lumalabs/ComfyUI-LumaAI-API?tab=readme-ov-file

要求

在使用此节点之前,您需要有一个 LumaAI API 密钥。在这里获取一个。如果要使用图像作为输入,则需要托管它们。作为建议,您可以使用 ImgBB 来托管您的图像。

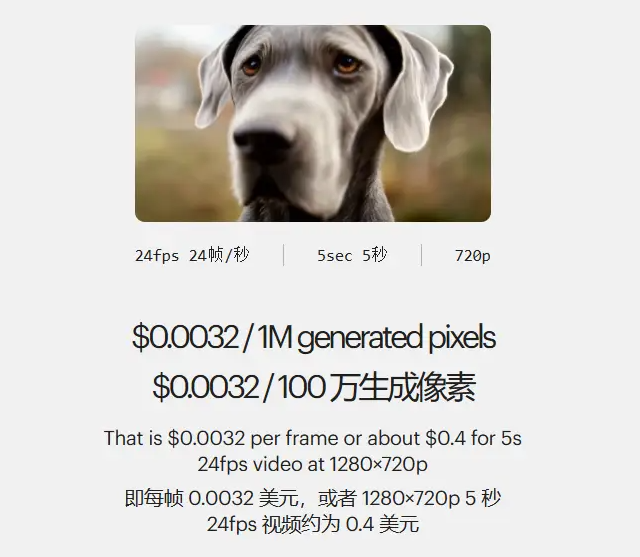

不过API是要钱的,这里是他们的定价,有需要的小伙伴可以去开通试试

手动安装

进入到ComfyUI/custom_nodes目录。

克隆此存储库:

git clone https://github.com/lumalabs/ComfyUI-LumaAI-API.git

路径应为ComfyUI/custom_nodes/ComfyUI-LumaAI-API/** ,其中表示此存储库中的所有文件。

Run cd ComfyUI-LumaAI-API && pip install -r requirements.txt 以安装依赖项。

如果您不想公开 Luma API 密钥,可以将其添加到config.ini文件中,并在节点中将其保留为空。

启动 ComfyUI 并享受使用 LumaAI API 节点的乐趣!

Manager 安装

打开 ComfyUI-Manager 并安装 LumaAI API 节点(ComfyUI-LumaAI-API)。

工作流下载:

github.com/lumalabs/ComfyUI-LumaAI-API/tree/main/workflows

0

© CopyRight 2002-2024 ,CHINAZ.COM , Inc.All Rights Reserved.