第一篇:Flux Lora训练日记:记录第一次训练Flux Lora的过程 (chinaz.com)

第二篇:Flux Lora训练日记(二):记录第一次训练Flux Lora的过程 (chinaz.com)

只从第一次训练的flux模型后,我又陆陆续续训练了 3 个模型,模型均以上传到哩布虽然没什么下载量,不过下面还是简单分析复盘一下我训练模型的过程

关于素材

素材的收集其实是非常重要而且关键的一步,我一般训练都会使用 20 张左右的素材来保证我整体的训练步数尽可能的多。

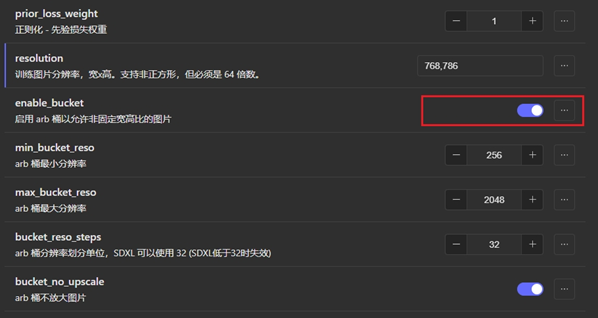

Flux的训练图片是可以大小不一的,前提是你需要开启arb桶,你可以是4:3,1:1,16: 9 的都可以,这对sdxl和sd15 也同样适用。

获取的素材可以大小不一但是需要尽量清晰。

如果你的训练集太少,你可以用一张图的裁切或者翻转来让训练集更多样化

关于打标签

之前说过训练flux Lora模型是不需要太多标签的,不过现在要分训练的类型讨论。

产品类

简单标签容易泛化。像手机壳的模型,我只是简单的标签最后Lora的效果并不好,有时候出图都不是Iphone16 的形状。

如果你用简单的标签,flux可能只知道你给他看的东西叫手机,但是FLux这个模型里本来也认识很多手机,然后你又给它认识了新的手机,所以出图的时候可能就是有几率出Iphone16 也有几率出其他手机。

后来我使用JoyCaption对手机壳的外观描述做了详细的打标,你需要告诉Flux 手机的摄像头就长这样,它才会记住手机的形状。

画风类

对于画风的情况我们是可以少用标签的,你可以类比人类认识画风的过程,比如梵高的画风非常的鲜明,你看过星空再看向日葵似乎就能想到这可能是梵高画的,并不需要更细节的画面提示来让你想起梵高。FLux也是一样,你只需要给它大量的画风素材,然后使用简单的标签做一个联系即可。

在C站上我们也可以看到这个画风模型,训练的步数非常多,但也没有特定的触发词,只需要告诉FLux你想要的复古动漫的确切风格

我在训练时也是这样,只用了简单的两个标签

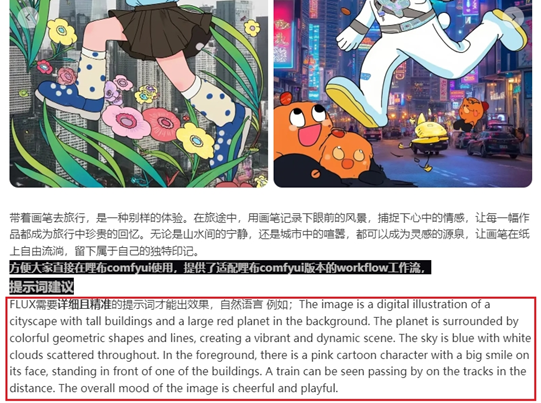

虚实结合

这个模型是需要多一点的标签的,因为FLux模型大概率是不认识这些画面的,所以你需要一些标签去引导FLux去结合现实背景和卡通人物。

所以我选择了miaoshouAI去反推提示词:

超越JoyCaptain速度更快更准确显存更低的图像反推Florence2PromptGen,适配Flux打标 (chinaz.com)

用这个反推有个好处就是可以反推画面结构,但是不会太细致,太细致可能也会限制FLux的想象力,我认为虚实结合这种场景更多的是让FLux把训练集中人物的动作和场景结合起来,所以标签大多数都是描述人物和场景

我之前介绍过几种虚实结合的模型:【Flux】 4 款虚实结合的Flux Lora推荐!适合做壁纸,发朋友圈 (chinaz.com)

你可以去观察他们的提示词一般都要比较丰富的

关于训练步数

这个我建议训练步数多一点,轮数也多一点,可以大力出奇迹。

我习惯是训练个 10 多轮,每两轮保存一个模型,这样训练一次至少有5, 6 个模型,总有一个效果还行

每张图片的重复次数10- 20 之间,f我一般会控制在总训练步数2000- 4000 步之间

以上就是我最新训练的一些经验,不一定都是对的,可能也有错误的地方,大家参考一下就行,没必要完全按我的方法训练,Flux还是非常聪明的。也欢迎各位炼丹爱好者的加入我们交流群交流学习心得,

1

© CopyRight 2002-2024 ,CHINAZ.COM , Inc.All Rights Reserved.